Hay un problema incómodo en la inteligencia artificial que durante mucho tiempo se ha ignorado porque el resultado parecía suficientemente bueno.

Los modelos de lenguaje responden bien. A veces incluso impresionan.

Pero en entornos reales, eso no es suficiente.

👉 Porque no necesitas respuestas plausibles

👉 Necesitas respuestas correctas, trazables y basadas en tu contexto

Y ahí es donde aparece RAG.

El problema que RAG viene a resolver

El documento lo plantea sin rodeos: la dependencia exclusiva de modelos entrenados externamente introduce un riesgo claro en entornos corporativos

- información desactualizada

- falta de contexto específico

- imposibilidad de trazabilidad

- riesgo de cumplimiento

Esto no es un problema técnico menor.

Es un bloqueo directo para adoptar IA en serio.

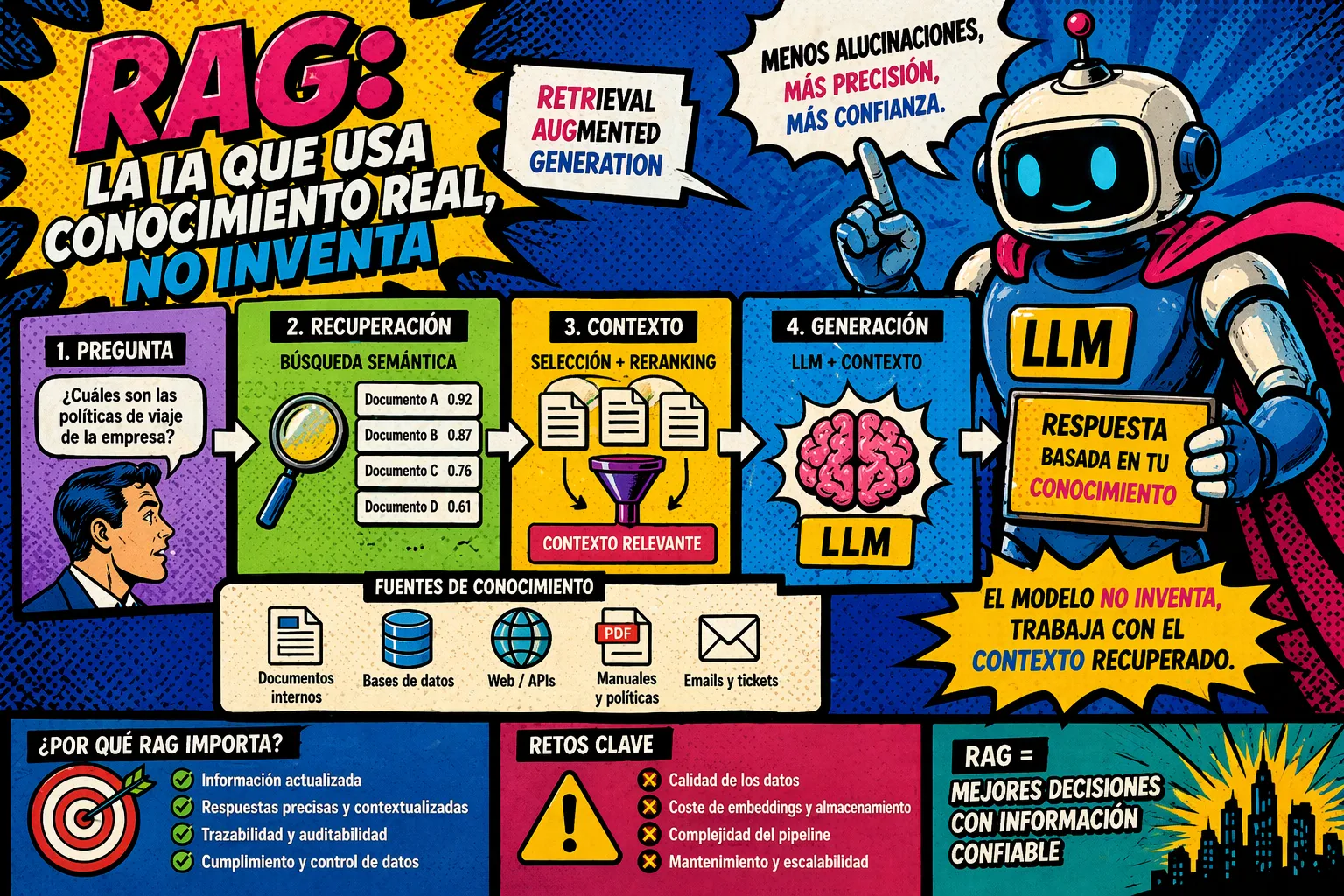

Qué es RAG (sin simplificaciones)

RAG —Retrieval Augmented Generation— no es una feature.

Es una arquitectura.

Lo que hace es simple de explicar, pero complejo de diseñar bien:

- Recupera información relevante

- La inyecta como contexto

- Genera una respuesta basada en ese contexto

👉 El modelo deja de responder “desde lo que sabe”

👉 Y pasa a responder “desde lo que encuentra”

La arquitectura real detrás de RAG

Aquí es donde empieza el trabajo de verdad.

Un sistema RAG típico introduce nuevas piezas en tu arquitectura:

1. Ingesta y segmentación (chunking)

El documento insiste en esto:

la calidad del sistema depende directamente de cómo divides la información

- chunks demasiado grandes → pierdes precisión

- chunks demasiado pequeños → pierdes contexto

No es trivial. Es diseño.

2. Embeddings y base de datos vectorial

Cada fragmento se transforma en una representación matemática.

Esto permite:

- buscar por significado (no por texto exacto)

- recuperar información relevante aunque no coincida literalmente

Aquí entran componentes como:

- vector databases (Pinecone, Weaviate, etc.)

- modelos de embeddings

3. Recuperación + reranking

No basta con encontrar resultados.

El documento introduce una capa clave: 👉 el reranking

Un filtro adicional que:

- ordena por relevancia real

- reduce ruido

- mejora la calidad del contexto final

4. Generación controlada

El LLM entra aquí.

Pero con una diferencia fundamental:

👉 No genera libremente

👉 Genera condicionado por el contexto recuperado

Esto cambia completamente su comportamiento.

Lo importante: el modelo deja de “inventar”

Este es el punto más importante del documento:

el modelo final no inventa información, trabaja con el contexto proporcionado

Esto tiene implicaciones enormes:

- trazabilidad

- auditabilidad

- confianza

- cumplimiento normativo

RAG no mejora el modelo.

👉 Hace el sistema usable en empresa

Problemas reales que introduce (y no te cuentan)

RAG no es gratis.

El documento señala varios puntos críticos:

Coste

- generación de embeddings

- almacenamiento

- consumo de tokens

Complejidad

- pipeline de datos

- sincronización de información

- mantenimiento de índices

Calidad de datos

- duplicados

- inconsistencias

- documentos similares

👉 Si tu dato es malo, RAG amplifica el problema.

Escalabilidad y decisiones arquitectónicas

El documento propone algo interesante:

👉 tras validar el caso de uso, moverse a soluciones open source o autogestionadas

Esto tiene sentido:

- control de costes

- control de datos

- flexibilidad arquitectónica

Pero también implica:

- más responsabilidad operativa

- más complejidad

Lo que cambia realmente

RAG no es una mejora incremental.

Es el paso de:

- IA como asistente genérico

👉 a - IA como sistema experto sobre tu conocimiento

El valor de RAG no está en generar mejores respuestas.

Está en controlar de dónde vienen.